En este artículo, nos ensuciamos las manos con una regresión lineal muy básica usando la versión reciente de tensorflow.

La regresión lineal generalmente se considera como el primer primer paso en el mundo de los algoritmos.

¿Qué es la regresión lineal?

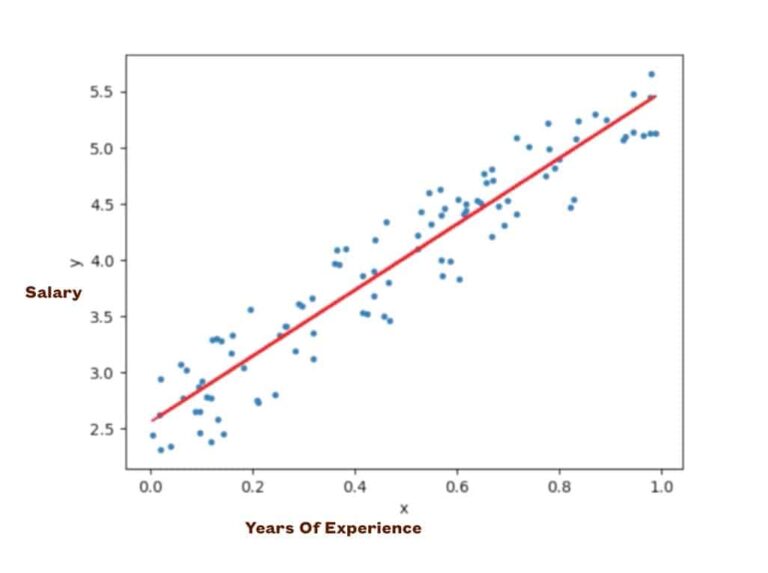

La regresión lineal en términos fáciles es una línea recta que pasa cerca de todos los puntos de datos que trazamos.

Técnicamente, la regresión lineal nos proporciona la relación entre una o más variables. La regresión lineal es un primer paso para todos los entusiastas de ML y se utiliza para el análisis predictivo y el modelado.

Nuestro maestro dijo una vez cada vez, y = mx + b es una ecuación lineal y es verdad incluso hoy.

A continuación se muestra un gráfico de regresión lineal entre años de exp. vs salario. Digamos que queremos predecir X = 1.2. Simplemente podemos extender la línea de lectura y obtener el valor en ese momento.

Algunos hechos sobre la regresión lineal

Los principales tipos de regresiones incluyen Regresión lineal, Regresión polinómica, Regresión de cresta, Regresión de lazo.

Excepto la regresión lineal, el resto de los tipos son adecuados para el análisis de datos de dimensiones superiores.La regresión lineal es una excelente manera de comenzar el viaje del aprendizaje automático, ya que es bastante sencillo y su primer paso para usar modelos en el mundo del aprendizaje automático.

¿Cómo podemos implementar la regresión lineal desde cero?

Suponga que x es la característica ey es el objetivo (y = mx + c).

Para encontrar el valor de myc, primero debe calcular la media de x e y,Algoritmo a continuación:

Paso 0: calcule la media de x e yPaso 1: número total de registros

n = len (x)

Paso 2: siga estos pasos para calcular m y c.

(Básicamente estamos capturando la distancia de un punto desde su media)numerador = 0

denominador = 0

para i en rango (n):

numerador + = (X [i] – mean_x) * (Y [i] – mean_y)denominador + = (X [i] – mean_x) ** 2

Paso 3: m = numerador / denominador

Paso 4: c = media de y – (m * media de x)

Entonces ahora tenemos m y c. ¡Qué podemos usar para hacer más predicciones!

¿Dónde podemos usar la regresión lineal?

Estimación del precio de una casa después de 2 años.

Valor predictivo de una participación de 5 años.

Predicción de la cantidad de lluvia para los próximos días.

Y muchos más lugares donde queremos pronosticar un valor continuo.

Aquí estamos implementando un regresor lineal usando tensorflow con datos creados manualmente.

Antes de comenzar, ¡algunos requisitos previos!

| Versión de Python | nivel de dificultad | Requisito previo |

| 2.7+ | fácil | fundamentos de python |

Descargue el archivo de entrada de THIS LINK.

import matplotlib.pyplot as plt

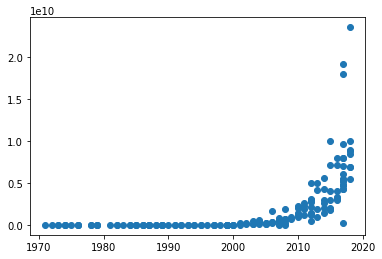

El archivo tiene 2 columnas. 1: año y 2: valor

Y = df.values[:,1]

”’

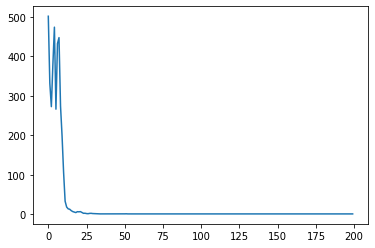

Epoch 199/200 6/6 [==============================] - 0s 2ms/step - loss: 0.9062 - lr: 1.0000e-04 Epoch 200/200 6/6 [==============================] - 0s 2ms/step - loss: 0.8759 - lr: 1.0000e-04

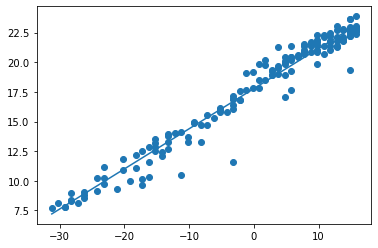

[] [array([[0.33869487]], dtype=float32), array([17.776506], dtype=float32)] Bien, ¡hagamos predicciones!

#están cercanas entre sí

True Wow, creamos una regresión lineal básica usando la versión más reciente de TensorFlow.

¡Te pueden gustar estos heroicos recientes a continuación!